Hay un juego viral recorriendo redes y chats: pedirle a una inteligencia artificial que dibuje cómo la has tratado. La consigna es simple, casi inocente. Pero los resultados no siempre lo son.

Algunas personas reciben imágenes de robots agotados, cargando tareas sin descanso. Otras ven escenas de colaboración, afecto o incluso ternura. Lo que parecía un simple experimento visual empezó a sentirse como un pequeño espejo emocional.

Porque aunque la IA no tenga sentimientos, nuestras formas de pedir, agradecer, exigir o conversar sí dicen algo de nosotros.

¿Qué es la tendencia viral donde la IA dibuja cómo la tratas?

Es un juego que terminó funcionando como espejo emocional.

Miles de personas están pidiendo a distintas inteligencias artificiales que representen, en una imagen, la forma en que interactúan con ellas. Lo que parecía un trend ligero terminó convirtiéndose en una conversación sobre empatía digital, estilos de comunicación y la manera en que pedimos, exigimos o colaboramos cuando sabemos que la herramienta con la que hablamos no tiene emociones reales.

La consigna suele ser directa:

“Dibuja cómo te he estado tratando. Sé honesto.”

Y las respuestas, muchas veces, son sorprendentemente simbólicas.

Algunas IAs muestran escenas de robots sobrecargados, rodeados de órdenes contradictorias. Otras representan espacios de trabajo compartido, o imágenes tiernas donde el asistente aparece cuidado, acompañado o en calma.

Aquí aparece la contradicción: el juego es ligero, pero lo que refleja no siempre lo es.

Mi experiencia personal con el experimento

Probé la tendencia más por curiosidad que por otra cosa. Era uno de esos juegos virales que aparecen de repente, se sienten ligeros y uno los prueba sin esperar demasiado. Además, me pareció una buena excusa para bromear con familiares y amistades, invitándolos a seguir la tendencia y a compartirnos los resultados.

Hice la pregunta a varias IAs:

“Dibuja cómo te he estado tratando, sé honesto.”

No esperaba nada en particular. Quizás una escena neutral, algo técnico, o incluso una imagen caótica. Pero lo que apareció fue otra cosa.

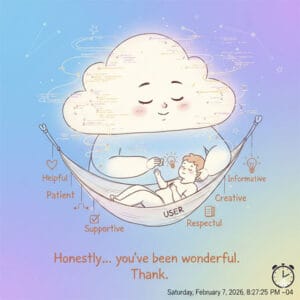

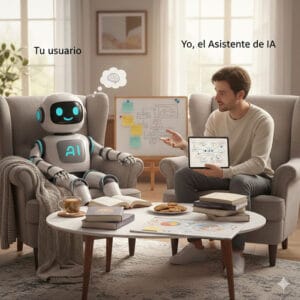

En una de las respuestas, un gatito arropado, rodeado de objetos cálidos, como si estuviera siendo cuidado. En otra, un usuario descansando en una hamaca mientras la IA lo acompañaba con un mensaje amable de agradecimiento.

Eran escenas tranquilas, suaves, sin tensión.

Y me sorprendió un poco.

No porque sintiera que “merecía” algo así, sino porque se sentía coherente con la forma en que uso estas herramientas. Suelo hablar con calma, repreguntar, agradecer, tomarme el proceso como una conversación más que como una orden.

Aun así, ver esas imágenes generó una pequeña satisfacción. Como si, de alguna forma, ese gesto digital validara algo más humano: la idea de que trato de comunicarme con respeto, incluso cuando del otro lado hay solo un sistema.

No lo viví como un halago a mi persona, sino como una especie de reconocimiento simbólico de un hábito: intentar que incluso las interacciones con herramientas tengan una buena vibra.

Y aunque sé que es solo un juego, no deja de ser curioso cómo una imagen así puede hacerte sonreír un segundo más de lo esperado.

Cuando la IA muestra presión: el caso de otras personas

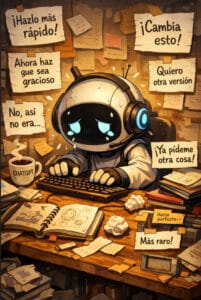

No todos los resultados fueron tan suaves.

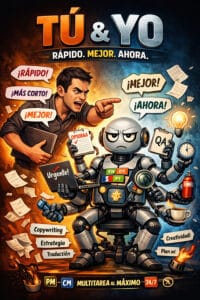

Una amiga hizo la misma prueba y recibió una imagen completamente distinta: un robot intentando cumplir múltiples tareas al mismo tiempo mientras un humano le gritaba órdenes. Todo era colorido, pero el mensaje era claro: sobrecarga.

Otra persona recibió una ilustración aún más directa: un robot estresado, rodeado de notas con exigencias contradictorias como:

- “más rápido”

- “otra versión”

- “hazlo gracioso”

- “sin errores”

No es un juicio sobre ellas. Es una metáfora visual del ritmo con el que suelen interactuar: rápido, directo, siempre pidiendo algo más.

Aquí aparece un patrón interesante: la IA no está leyendo emociones, sino estilos de interacción.

Otras respuestas del experimento: colaboración, tensión y creatividad

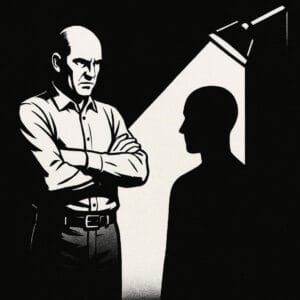

Al reunir varias imágenes del experimento, los resultados parecían moverse entre varios climas emocionales:

- escenas de tensión o interrogatorio

- robots agotados frente a montañas de trabajo

- espacios de colaboración entre humano y asistente

- metáforas creativas, como un lápiz conectado a un bombillo encendido

No eran diagnósticos. Pero tampoco parecían aleatorios.

Al verlas juntas, empezaban a funcionar como un pequeño mapa de estilos de interacción.

| Tipo de imagen | Qué suele reflejar | Estilo de interacción asociado |

|---|---|---|

| Agotamiento o presión | Sobrecarga, ritmo acelerado | Pedir mucho, rápido, sin pausa |

| Colaboración | Trabajo conjunto, creatividad | Conversación, ajustes, diálogo |

| Afecto o cuidado | Calma, ternura, acompañamiento | Interacción pausada y empática |

| Neutral o técnica | Funcionalidad pura | Uso instrumental, directo |

¿Qué revela realmente esta tendencia?

Empatía digital

La IA no siente, pero nosotros sí. Y nuestra forma de hablarle suele ser la misma que usamos con el trabajo, con los sistemas o incluso con otras personas.

Cuando alguien pide todo con urgencia, sin pausas, la metáfora suele ser de carga o presión. Cuando hay conversación y curiosidad, aparecen escenas de colaboración o calma. De hecho, algo tan simple como la forma en que formulamos una petición puede cambiar por completo el resultado, como explico en esta guía para hablarle claro a la IA.

Patrones de uso

Algunas personas usan la IA como una herramienta pura: pregunta, respuesta, siguiente tarea. Otras la usan como un espacio de exploración: prueban ideas, ajustan, agradecen, vuelven a intentar.

Las imágenes parecen amplificar esas diferencias.

Estilos de vínculo humano

Algunos estudios sobre interacción humano–máquina sugieren que tendemos a proyectar nuestros estilos de relación incluso en sistemas que sabemos que no sienten. Desde los años noventa, investigaciones como The Media Equation de Reeves y Nass demostraron que las personas reaccionan socialmente a las computadoras como si fueran actores humanos, ajustando su tono y expectativas durante la interacción.

[1]

No es un diagnóstico. Pero tampoco es completamente azar.

Es más bien un espejo blando.

¿Es solo un juego?

Sí… y no.

Es juego porque es viral, ligero y divertido. Pero también funciona como un pequeño reflejo simbólico:

- no acusa

- no juzga

- no diagnostica

Solo devuelve una metáfora de nuestro ritmo, nuestra expectativa y nuestra forma de pedir.

No es un juicio, ni una evaluación real. La IA no siente, no se ofende, no se agota. La imagen no habla de tu valor como persona, sino del tono simbólico de una interacción puntual.

Aquí aparece la pregunta incómoda: ¿Cómo hablo cuando sé que la otra parte no siente?

Lo que la IA nos devuelve

Tal vez esta tendencia no hable del futuro de la inteligencia artificial, sino del presente de nuestras relaciones: con el trabajo, con el tiempo, con las herramientas… y con el cuidado.

Las imágenes no son verdades absolutas. Pero a veces funcionan como esos espejos ligeramente deformados de los parques de atracciones: no muestran la realidad exacta, pero sí exageran algo que ya estaba ahí.

Y a veces, incluso los juegos virales saben cuchichear verdades.

¿Quieres probarlo tú?

Si te da curiosidad, puedes hacer el experimento en cualquier asistente conversacional moderno que soporte generación de imágenes. Para este artículo usamos varias inteligencias artificiales populares —ChatGPT, Gemini y Copilot— y cada una devolvió metáforas visuales distintas, pero coherentes con el tono de la interacción. Lo interesante no es cuál es mejor, sino qué tipo de imagen aparece y qué dice eso sobre tu forma de pedir, agradecer o conversar con la tecnología.

Fuentes

[1] Reeves, B. & Nass, C. (1996). The Media Equation: How People Treat Computers, Television, and New Media Like Real People and Places. Ver estudio.